TAG:Transformer

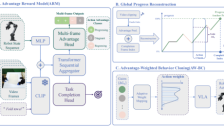

具身智能公司提出新方法,解决困扰机器人长程任务多年的“奖励瓶颈”问题

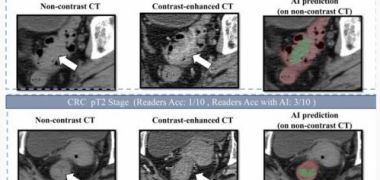

文章聚焦机器人长程任务中的“奖励瓶颈”,介绍逐际动力联合高校提出的ARM框架:以“前进/后退/停滞”三态相对优势替代绝对进度估计,并结合MIMO时序Transformer、自动化进度重建与AW-BC训练策略,显著提升长视界操作学习效率与稳定性,在双手毛巾折叠任务中实现99.4%成功率。

GEN-1和千寻的共识:历史不会重复,但具身智能正在押韵Transformer

本文将具身智能的当前发展与2018年Transformer引发的大模型革命相类比,揭示了行业突破性进展。美国Generalist AI的GEN-1模型通过海量人类行为数据预训练,显著提升物理操作任务成功率并降低机器人数据依赖,被视为具身智能的“ChatGPT时刻”。文章强调,国内千寻智能与GEN-1在数据驱动、高效数据利用及可穿戴设备采集人类数据等技术路线上高度同频,预示着全球具身智能发展路径的收敛。这种颠覆传统“机器教学”的范式变革,有望解决行业“数据贵、落地难”的痛点,推动具身智能实现大规模落地,迈向

为Transformer注入长期记忆:Memo框架通过“学会做摘要”解决具身智能核心挑战

牛津大学研究团队提出Memo框架,为Transformer模型注入长期记忆能力。该框架模仿人类笔记行为,让模型自主生成任务相关的摘要标记,通过动态记忆缓冲区存储和检索关键信息,解决了传统Transformer在长序列任务中的记忆限制问题。实验表明Memo在具身智能任务中性能优异,上下文标记减少8倍,同时保持强大的长时域推理能力。

鲍威尔即将揭晓最终悬念,超级AI财报日今夜来临

2026-04-29

0 浏览

《Science》发布一项基于拓扑学的微型机器人研究:会“解扣起跳”的绳子刷新跳跃极限

2026-04-29

0 浏览

美股全线低开超3300股下跌,英伟达、特斯拉等齐跌,存储股走强希捷涨超17%,美联储将公布利率决议

2026-04-29

0 浏览

华科毕业生历时8年打造深圳独角兽企业,冲刺“全栈式智能机器人第一股”

2026-04-29

0 浏览

科创板数字芯片公司业绩会:细分赛道分化成长,国产AI算力及高端芯片加速突围

2026-04-29

0 浏览

机器人赛道一季度融资超百亿元:人形机器人与具身智能成主线,早期项目受资本追捧

2026-04-29

0 浏览

灵心巧手完成B+轮融资,开启自进化智能体新范式

2026-04-29

0 浏览

日本航空将于5月测试引入中国人形机器人,以应对老龄化压力

2026-04-29

0 浏览

奇瑞汽车一季度净利润41.7亿元:营收同比降3.45%,毛利增长超两成,海外销量占比超六成

2026-04-29

0 浏览

Happy Horse盲测“屠榜”与实测口碑分化,AI视频三强竞争白热化

2026-04-29

0 浏览