TAG:深度学习

AI仿生皮肤突破水下探测 机器人实现激流触觉感知

本文介绍浙大与新国大联合研发的AI仿生水下电子皮肤。受鲨鱼侧线启发,该皮肤结合仿生鳞片物理降噪与深度学习算法,能在湍流、高压及零能见度环境中精准识别微细纹理。该技术突破传统声呐与视觉局限,赋予水下机器人高精度触觉感知,为深海探测提供全新解决方案。

Cognichip获6000万美元融资 芯片设计迈入AI自进化时代

初创公司Cognichip完成6000万美元A轮融资,提出用AI设计芯片的新理念。其系统利用深度学习自动优化电路布局,大幅缩短研发周期并提升能效,破解高性能硬件开发瓶颈。资金将用于团队扩张与芯片流片,标志着半导体行业正迈向AI自进化与数据驱动时代。

深度机智发布PhysBrain 1.0 机器人获物理常识能力

深度机智发布全球首款基于人类学习范式的具身通用智能基座模型PhysBrain 1.0,该模型通过内化物理常识实现时空一致性和泛化能力,标志着具身智能从动作模仿向原理解构的跨越。这一突破为机器人提供了具备底层物理逻辑的智能基座,推动AI向物理世界认知迈进。

毫瓦级超声波助力手掌大飞行机器人突破浓雾黑暗复杂障碍

《Science Robotics》最新研究展示了一款名为“Saranga”的超声波感知系统,能让手掌大小的飞行机器人在浓雾、黑暗、积雪及复杂障碍环境中自主导航。该系统采用毫瓦级超声波传感器和深度学习算法,克服了传统视觉和激光雷达的局限,为无人机在极端环境中的应用提供了新思路。

世界模型走向轻量化?LeCun团队与清华团队提出两条路径

本文聚焦世界模型领域的两项前沿进展:Yann LeCun团队提出的LeWorldModel通过简化JEPA框架实现从像素端到端训练,大幅降低复杂度并验证物理结构编码能力;清华大学团队的Fast-WAM则挑战传统WAM范式,提出测试阶段无需显式未来想象的高效替代方案。两篇工作从不同角度推动世界模型向更简洁、高效演进,为具身智能发展提供新思路。

伊迪斯科文大学开发新技术通过AI面部分析检测危险驾驶

伊迪斯科文大学研究人员开发出基于AI的面部分析技术,可同时检测血液酒精浓度、疲劳驾驶和情绪状态,准确率高达95%。这项创新技术有望替代传统侵入式检测方法,为道路交通安全提供实时监测方案。

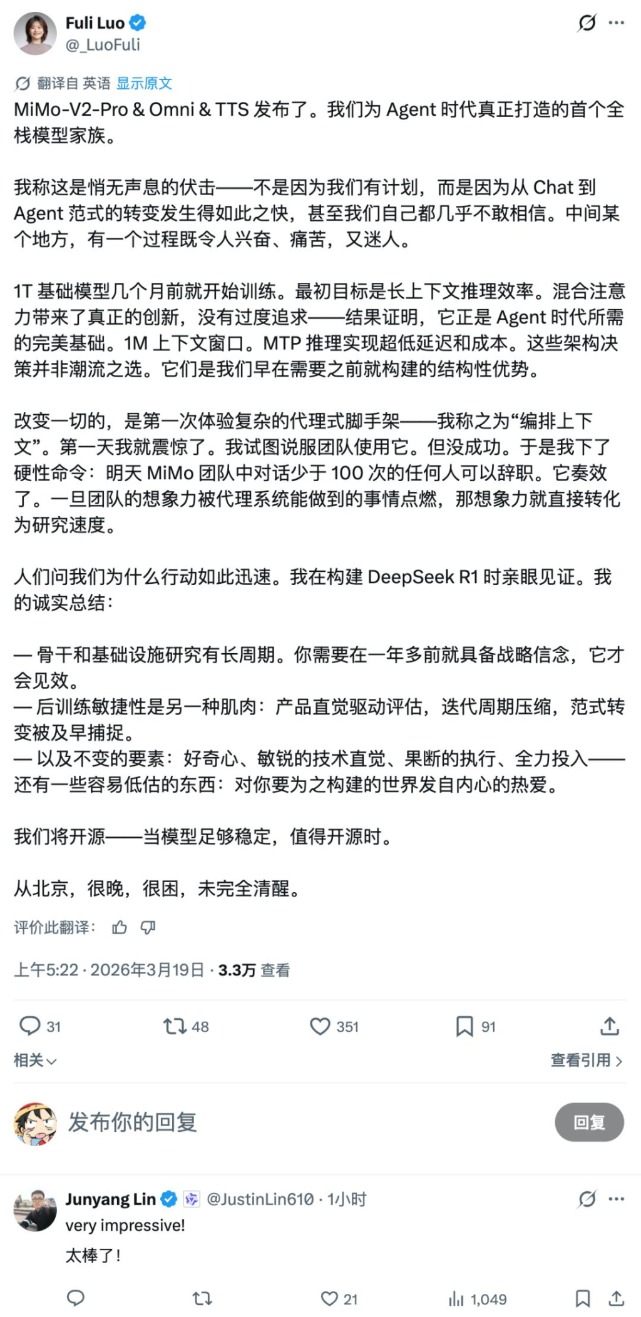

小米深夜连发三款模型 罗福莉称专为智能体时代设计 曾被误认DeepSeek V4

小米凌晨发布三款AI大模型,包括旗舰基座模型Xiaomi MiMo-V2-Pro、全模态基座模型Xiaomi MiMo-V2-Omni和语音合成模型Xiaomi MiMo-V2-TTS。其中MiMo-V2-Pro在全球大模型综合智能排行榜上位列第八,专为Agent场景优化,支持1M超长上下文,展现了小米在AI领域的强劲实力。罗福莉团队此次低调发布,却引发行业广泛关注。

开源界重磅发布Mistral Small 4 性能提升更省资源

Mistral AI 正式发布开源大模型 Mistral Small4,采用128专家混合架构,整合了逻辑推理、多模态处理和智能体编码三大能力,性能更强且算力开销更低。支持256k超长上下文窗口和可配置推理强度,为开发者提供高效全能底座。

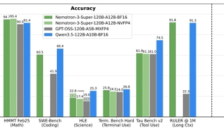

NVIDIA开源大模型Nemotron 3 Super性能媲美GPT-5.4

英伟达发布开源大模型Nemotron 3 Super,采用创新的Mamba-MoE混合架构,推理速度提升300%,性能直逼GPT-5.4。该模型支持1M超长上下文,已在多项权威测评中表现优异,并被多家科技巨头集成。

斯坦福李飞飞团队提出新框架 机器人可从错误中学习

斯坦福李飞飞团队提出全新 Reflective Test-Time Planning 框架,赋予机器人类人的反思能力,使其能从错误中学习并优化决策。该框架通过三重反思机制,显著提升任务成功率,展现出强大的实际应用潜力。

全球仅7人能赢!Gemini 3 Deep Think发布,碾压编程与科研榜单

Google最新发布的Gemini 3 Deep Think模型在深度推理领域实现重大突破,不仅在Codeforces编程竞赛中达到全球顶尖人类选手水平,还在科学研究和工程应用上展现卓越能力,包括发现学术论文漏洞、证明数学难题以及高效生成3D模型,标志着AI推理能力迈入新阶段。

谷歌DeepMind发布D4RT 赋予AI四维视觉能力

Google DeepMind推出革命性AI模型D4RT,通过融合三维空间与时间维度,赋予AI穿透时空的四维视觉能力。该模型采用统一架构,能实时追踪动态场景、重建3D结构并预测物体运动轨迹,运行速度比现有技术快18到300倍,为机器人导航、增强现实等领域带来突破性进展。

顶刊发布!失明患者迎来新希望 机器人视网膜静脉插管系统问世

约翰斯·霍普金斯大学团队在《Science Robotics》发表突破性研究,开发出基于深度学习的自主视网膜静脉插管系统。该系统利用三个卷积神经网络实现微米级精准操作,在离体猪眼实验中成功率高达90%,并能实时补偿眼部运动。这项技术突破了人类手部震颤的生理极限,大幅简化手术流程,为视网膜静脉阻塞患者提供了精准、高效的新治疗希望,有望推动高难度眼科手术的普及化。

谷歌DeepMind推出Gemma Scope 2,为Gemma 3模型提供全栈可解释性工具

谷歌DeepMind发布Gemma Scope 2,这是一个开放的可解释性工具套件,专为Gemma 3语言模型设计,支持从2.7亿到270亿参数的模型。该工具通过稀疏自编码器和转码器,帮助研究人员深入分析模型内部特征,追踪幻觉、越狱等行为,提升AI安全与对齐能力。

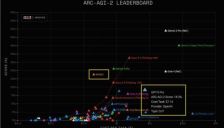

英伟达小模型成本仅为GPT-5 Pro三十六分之一

英伟达4B小模型NVARC在ARC-AGI2评测中以27.64%的成绩超越GPT-5 Pro,同时单任务成本仅为20美分,远低于对手的7美元。文章详细介绍了其零预训练深度学习方法和创新的合成数据管道,展示了小模型在特定领域的高效适应性和成本优势。